Figure 人形机器人使用 Helix VLA 模型展示家务

Figure AI 公司日前展示了其 Helix 视觉语言动作 (VLA) 模型在简单家务中的能力:收纳杂货。在人类发出一个简单的指令后,视频中的机器人会视觉评估场景,然后协同工作识别每个物体,并将物体移动到厨房的适当位置。

视频中有一些值得注意的发现:首先,机器人独立地处理放置在它们面前的物品,直到明显地需要将一些物品移交给另一个机器人,以便将物品送到另一个机器人可以触及的地方。

其次,机器人之间没有进行口头交流,但它们在互动过程中会出现明显的停顿,彼此凝视,进行着一种怪异的“心灵感应”互动。Figure 表示,监督式 AI 架构将整体目标分解成更小的子任务,同时独立控制每个机器人。

这是我们第一次看到两个类人机器人协同工作。

Figure 展示了 Figure 人形机器人协同处理杂货的能力。| 图片来源:The Robot Report

为了完成请求的任务,机器人会关上抽屉,关上冰箱门,并将碗放在柜台边上。这些都是对人类来说直观的子任务,但它们并没有在请求中明确说明。Figure 表示,这证明了训练动作的完整性。

在另一篇博文中,该公司解释了演示中机器人监督式 Helix 系统的架构。Helix 系统的核心是 VLA 模型,该公司表示,该模型正在成为所有类人机器人制造商的关键技术。

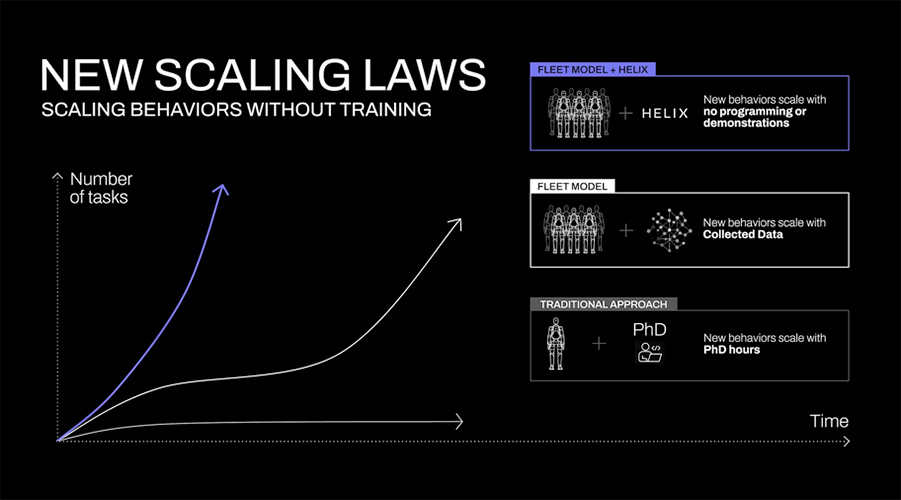

不同方法在获取新机器人技能方面的扩展曲线。在传统的启发式操作中,技能随着手动编写脚本的博士学位而增长。在传统的机器人模仿学习中,技能随着收集的数据而扩展。使用 Helix,可以使用语言即时指定新技能。| 图片来源:Figure AI

The Robot Report 在 2023 年加州圣克拉拉举行的 RoboBusiness 活动上首次看到了基于 LLM 的机器人引导的现场演示。在主题演讲中,Agility Robotics 首席技术官 Pras Velagapudi 通过一段视频让观众惊叹不已,视频中展示了 Digit 类人机器人通过响应简单的语音指令“清理房间”来清理杂乱的房间。

一年半后,Figure Helix 的这次演示依然令人印象深刻,因为它现在运行在机器人身上,并且 VLA 已经完全编码和测试。Figure 表示,它是通过收集大约 500 小时的高质量、多机器人、多操作员数据集,这些数据集包含各种遥控行为来生成 VLA 的。

为了生成自然语言条件的训练对,该公司使用自动标记 VLA 生成事后指令。VLA 处理来自机器人机载摄像头的分割视频片段,并提示:“你会给机器人什么指令才能获得视频中看到的动作?”

Figure 展示 Helix 功能

Figure 的 Helix VLA 模型代表了机器人和 AI 领域的一项重大进步,特别是在它与之前的 VLA 模型的不同之处。以下是其主要区别的细分:

1. 全身躯控制

-

- 灵活性:Figure 展示了 Helix VLA 模型对整个类人机器人上半身进行高速、连续控制。这包括躯干、头部、手腕和单个手指,拥有 35 个自由度 (DoF)。这种灵活性似乎比之前的模型更复杂,对物体的操控也更加细致入微。

- 类人动作:控制整个上半身的能力使 Helix 能够以更像人的动作和协调性执行任务。例如,它可以利用头部跟踪自己的手,以实现视觉对齐,并调整躯干以获得最佳的伸手范围,同时保持精确的手指动作以抓取物体。

2. 多机器人协作

- 协作任务:Figure 展示了 Helix 同时在两个机器人上运行,使它们能够在共享任务上进行协作。这为更复杂、更协调的动作打开了可能性,例如两个机器人共同收纳杂货或组装家具。

- 零样本泛化:根据演示的设置,机器人协作完成的任务涉及它们从未(据称)遇到过的物体。如果机器人从未见过这些物体,那么它就证明了该模型能够泛化并适应新情况。

3. “拿起任何东西”的能力

- 通用物体识别:演示展示了 Helix 如何使 Figure 类人机器人能够识别和操控各种家用物品。使用 VLA 比之前的模型有所改进,之前的模型通常需要针对每个物体进行专门的训练。

- 自然语言提示:机器人展示了对自然语言命令的理解和响应,允许用户指示它“拿起甜点”或“将一袋饼干递给右边的机器人”,而无需提供详细的说明。

4. 统一的神经网络

- 单个模型用于所有行为:与之前通常需要为不同任务使用单独模型的方法不同,Helix 似乎使用一组神经网络权重来处理所有行为。这简化了模型,使其更加高效。

- 无需针对特定任务进行微调:Helix 可以执行各种任务,而无需针对每个特定任务进行微调。Figure 表示,这使其更具适应性,也更容易在不同的环境中使用。

5. 商业化准备就绪:

- 机载处理:Helix 完全运行在 Figure 02 类人机器人中的嵌入式 GPU 上,功耗低,使其适合在现实世界中部署,而无需依赖外部计算资源。这是使类人机器人能够在家庭和其他环境中商业化应用的关键一步。

- 降低延迟:机载处理降低了延迟,使机器人能够快速响应命令并实时与其环境进行交互。

生产试验正在进行中

Figure 在 2024 年底宣布,其机器人正在将开发和试验转向商业应用,并且已经向付费客户交付了 Figure 02 系统。

Figure AI 因其快速创新步伐而获得了 2024 年 RBR50 奖。自 2023 年 1 月从隐身状态中脱颖而出以来,这家总部位于加州森尼维尔的公司已经构建并迭代了一个可工作的类人机器人,并在生产线上对其进行了测试。

上个月,Figure 表示计划将其机器人的电池、功能安全控制系统和电气系统认证为工业安全标准。该公司还声称,它打算在未来四年内交付 10 万台类人机器人,据报道正在与投资者谈判筹集 15 亿美元资金。

在机器人峰会上了解类人机器人

类人机器人将在机器人峰会与博览会上占据重要地位,该峰会将于 4 月 30 日至 5 月 1 日在波士顿举行,由 The Robot Report 的母公司 WTWH Media 主办。波士顿动力公司首席技术官 Aaron Saunders 将在活动第二天发表开幕主题演讲。他将讨论最近重新设计的 Atlas 机器人,并分享他对类人机器人未来的看法。

展会的首日将举办一个关于类人机器人现状的小组讨论,参与者包括 Velagapudi;ASTM International 机器人与自主系统主管 Aaron Prather;以及 Schaeffler 工程总监 Al Makke。该小组将探讨塑造类人机器人发展的技术和商业挑战。它还将分享早期部署的见解、未来展望以及正在进行的制定安全标准的努力。

机器人峰会与博览会将汇集 5000 多名致力于为各种商业行业构建机器人的开发人员。与会者可以深入了解最新的支持技术、工程最佳实践和新兴趋势。

该活动将有 200 多家参展商、70 多位演讲嘉宾、10 多个小时的专用网络时间、女性机器人早餐、职业博览会、创业公司展示等。RBR50 展馆和 RBR50 颁奖晚宴将重返展会,表彰年度 RBR50 机器人创新奖的获奖者。

立即注册,享受 40% 的会议通行证优惠!

本文最初发表于 The Robot Report。