火山引擎AICC机密计算重磅升级:开源Trusted MCP,实现全链路安全

在当前大模型技术变革的浪潮中,通常需要借助云端算力和存储资源,为终端用户提供更丰富的大模型应用场景体验。与此同时,业界对端云协作下的全链路安全和透明可信提出了更高要求。火山引擎AICC 机密计算正是在此背景下应运而生,旨在通过为企业构建“云端大模型安全屋”,实现公有云环境下敏感数据流转和计算的全链路安全。

近期,火山引擎 AICC 机密计算迎来重大升级,正式发布并开源了支持 MCP 的可信方案——Trusted MCP。通过此功能,开发者和企业能够确保 MCP 核心组件及其间通信数据的安全,有效解决 MCP 应用中可能出现的数据泄露和身份验证等风险。该新版本已在火山引擎官网上线。

构建可信MCP,发布即开源

随着 MCP(模型上下文协议)被广泛采纳,AI 调用大模型和工具的场景变得日益便捷和频繁。然而,这也带来了新的安全隐患:模型通过 MCP 协议与外部系统实时交互,使得安全边界从传统的“单一模型服务器”扩展至“全链路交互场景”。如果说传统安全防护主要聚焦于“模型本身”,那么在 MCP 生态下,攻击面将贯穿大模型应用的整个生命周期,安全风险呈指数级增长。

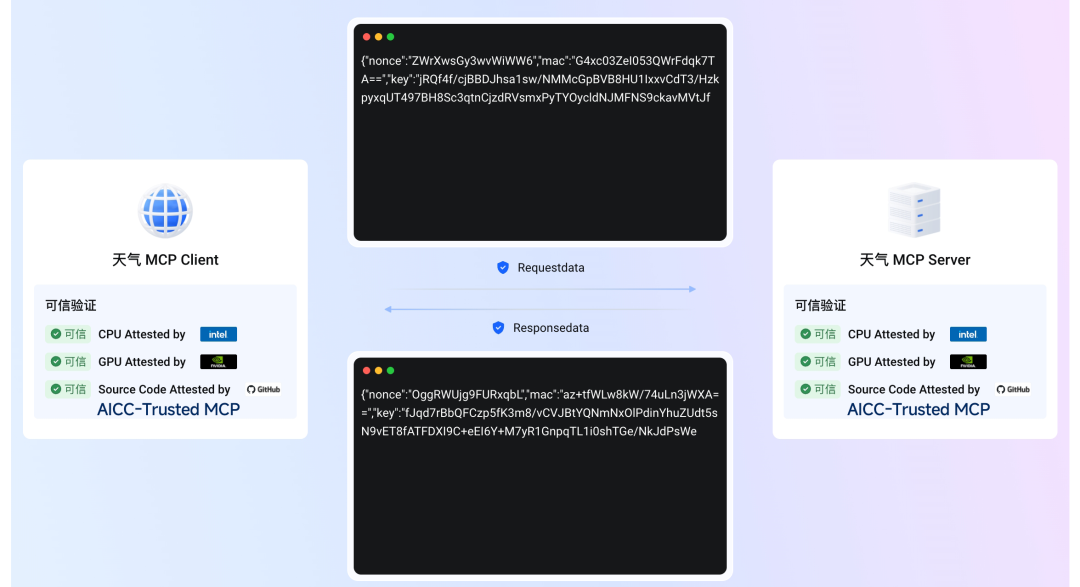

针对这些挑战,AICC 机密计算推出了 Trusted MCP(可信MCP)方案。该方案通过确保 MCP 协议本身及其组件间的安全通信,进一步推动了智能体技术的安全落地。

Trusted MCP 是一款基于 AICC 机密计算构建的可信 MCP 解决方案。它充分利用 AICC 机密计算的端云互信能力,为 MCP 的核心组件提供身份证明和验证,并在此基础上实现了全流程通信加密。这确保了 MCP 核心组件及组件间通信数据的安全,从而有效解决了 MCP 应用中可能出现的服务身份不可信、数据被篡改、流量劫持和数据隐私泄露等多种安全风险。

目前,AICC 机密计算的“Trusted MCP”核心代码已在 GitHub 上全面开源。其开源内容包括 Trusted MCP 整体框架、常用工具的桥接示例以及权限控制插件。开发者可以基于此快速集成内部工具,或积极参与共建更丰富的 MCP 工具仓库。

值得关注的是,针对安全增强版本的 Trusted MCP,业务改造几乎零成本,用户只需通过轻量级 SDK 即可轻松接入。

GitHub 地址:https://github.com/volcengine/AICC-Trusted-MCP

深化平台集成:AICC助力火山方舟实现机密推理

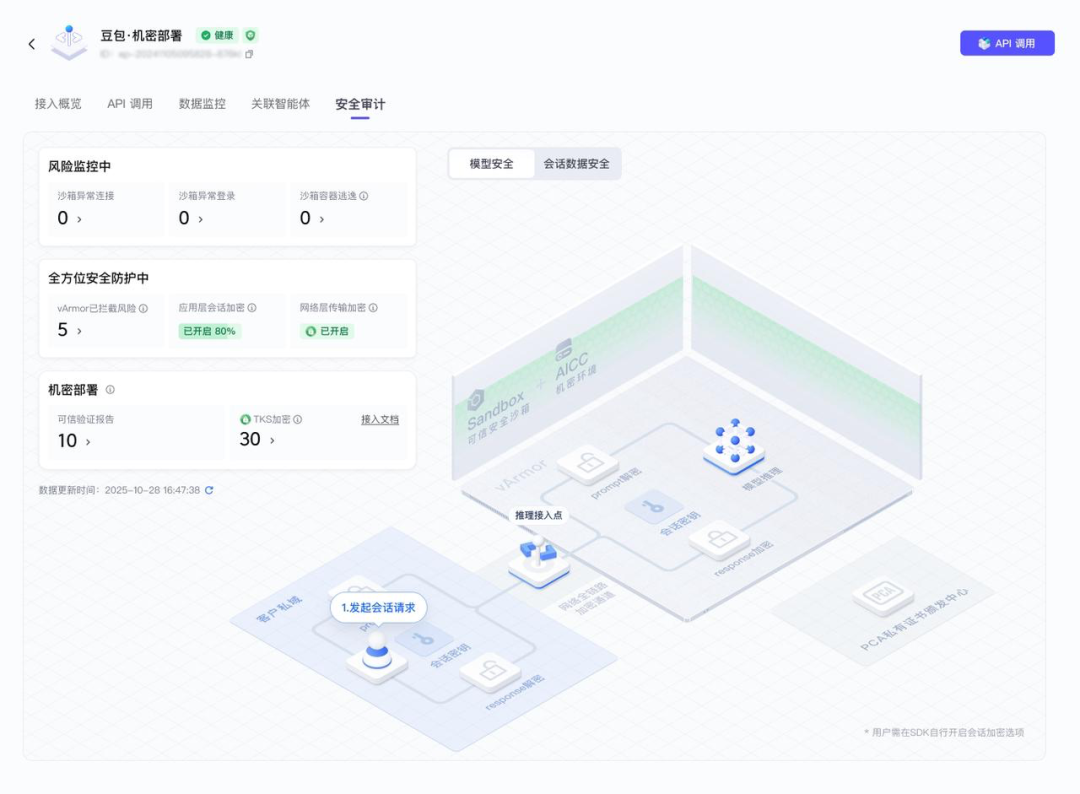

近期,作为一站式大模型服务平台,火山方舟已将 AICC 机密计算技术原生内置于其平台。这使得火山方舟在业内率先推出了 MaaS 原生的机密推理服务,用户只需选择“机密部署”方式,即可一键启动豆包大模型的机密推理服务。

通过此功能,用户可在火山方舟平台使用芯片级的机密推理服务,确保企业隐私数据在云端获得与本地同等高标准的计算保障。这进一步保证了企业在火山方舟平台上的数据“唯用户可见、唯用户所用、唯用户所有”。

此外,在火山方舟的后台,用户完成机密模型部署后,系统会自动生成实时可信验证报告。这份报告能够帮助用户确认推理服务是否已部署在硬件可信环境内,从而全面保障推理服务的安全性和可信度。

目前,AICC 机密计算 已在 PC、手机、汽车等多个行业具备了丰富的落地实践。例如:

-

在联想的个人可信云方案中,AICC 技术被用于构建可信知识库,实现了从内容创建、密态存储到加密检索与输出的全流程隐私闭环。用户在无需改变原有操作习惯的前提下,即可获得高效的智能反馈,充分体验到“安全无感”的服务。

-

在 OPPO 的 AI 私密云项目中,为向用户提供更优质的 AI 服务,涉及复杂请求的 AI 推理需通过云端大模型完成。OPPO 与火山引擎 AICC 合作,共同打造了私密计算云,实现了用户数据通过密文方式进行端云传输,确保了用户复杂需求在云上推理计算的同时,满足了数据在云端计算“不留痕”的高标准安全要求。

-

上汽大众基于豆包大模型,成功打造了智能知识助手“SVW Copilot·出众”,该助手旨在响应员工对企业内部各业务领域知识库的提问,从而有效提升办公事务效率。火山方舟的机密推理服务在此过程中发挥了关键作用,不仅帮助上汽大众充分盘活了内部知识资源,更在保障数据隐私与安全的前提下,实现了企业知识的智能化与分级化利用。

秉承“芯片级全链路加密”的核心理念,火山引擎 AICC 机密计算将持续专注于智能计算底座的高可用性、高性能和开放性。其目标是为企业在大模型接入和应用过程中,提供端到端的可信智能链路护航。