深度伪造技术泛滥:AI如何应对?

2024年,深度伪造事件激增,预计今年将增长60%以上,全球案例将超过15万起。这使得人工智能驱动的深度伪造攻击成为当今增长最快的对抗性人工智能类型。德勤预测,到2027年,深度伪造攻击将造成超过400亿美元的损失,其中银行业和金融服务业将成为主要目标。

人工智能生成的语音和视频伪造正在模糊可信度的界限,削弱人们对机构和政府的信任。深度伪造技术在国家级网络战组织中如此普遍,以至于它已成为网络战国家之间持续进行的攻击策略的成熟手段。

“在今天的选举中,人工智能的进步,例如生成式人工智能或深度伪造,已经从单纯的错误信息演变成复杂的欺骗工具。人工智能使得区分真实信息和伪造信息变得越来越困难,”Ivanti 首席产品官 Srinivas Mukkamala 告诉 VentureBeat。

62% 的首席执行官和高级商业主管认为,深度伪造将在未来三年内给他们的组织带来至少一些运营成本和复杂性,而 5% 的人认为这是一种生存威胁。Gartner 预测,到 2026 年,使用人工智能生成的深度伪造攻击面部生物识别技术将意味着 30% 的企业将不再认为此类身份验证和身份验证解决方案是孤立可靠的。

“Ivanti 最近进行的一项研究表明,超过一半的办公室工作人员 (54%) 不知道先进的人工智能可以模仿任何人的声音。考虑到这些人将参与即将到来的选举,这一数据令人担忧,”Mukkamala 说。

美国情报界 2024 年威胁评估指出,“俄罗斯正在利用人工智能创建深度伪造,并正在发展欺骗专家的能力。战区和政治不稳定环境中的人可能成为此类深度伪造恶意影响的一些最有价值的目标。”深度伪造已经变得如此普遍,以至于国土安全部发布了一份指南,名为“深度伪造身份的日益增长的威胁”。

OpenAI 的最新模型 GPT-4o 旨在识别和阻止这些不断增长的威胁。正如其 8 月 8 日发布的系统卡中所述,它是一种“自回归全能模型,可以接受任何文本、音频、图像和视频组合作为输入”。OpenAI 写道:“我们只允许模型使用某些预先选择的语音,并使用输出分类器来检测模型是否偏离了这些语音。”

识别潜在的深度伪造多模态内容是 OpenAI 设计决策的优势之一,这些决策共同定义了 GPT-4o。值得注意的是,该模型进行了大量的红队测试,这在最近一代人工智能模型发布中是行业中最广泛的测试之一。

所有模型都需要不断地从攻击数据中学习和训练,以保持其优势,尤其是在应对攻击者的深度伪造技术方面,这些技术正变得与合法内容难以区分。

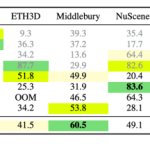

下表解释了 GPT-4o 的功能如何帮助识别和阻止音频和视频深度伪造。

来源:VentureBeat 分析

增强模型识别深度伪造能力的关键功能包括:

生成对抗网络 (GAN) 检测。GPT-4o 使用与攻击者创建深度伪造相同的技术来识别合成内容。OpenAI 的模型可以识别内容生成过程中以前无法察觉的差异,即使 GAN 也无法完全复制这些差异。例如,GPT-4o 分析了光线与视频片段中物体相互作用的方式中的缺陷,或语音音调随时间的变化不一致。4o 的 GANS 检测突出了这些肉眼或耳朵无法察觉的微小缺陷。

GAN 通常由两个神经网络组成。第一个是生成器,它生成合成数据(图像、视频或音频),另一个是鉴别器,它评估其真实性。生成器的目标是提高内容的质量以欺骗鉴别器。这种先进的技术创造了几乎与真实内容无法区分的深度伪造。

来源:CEPS 任务组报告,人工智能与网络安全。技术、治理和政策挑战,欧洲政策研究中心 (CEPS)。布鲁塞尔。2021 年 5 月

语音认证和输出分类器。GPT-4o 架构中最有价值的功能之一是其语音认证过滤器。该过滤器将每个生成的语音与预先批准的合法语音数据库进行交叉引用。这种能力的迷人之处在于,该模型如何使用神经语音指纹来跟踪超过 200 种独特的特征,包括音调、节奏和口音。如果检测到任何未经授权或无法识别的语音模式,GPT-4o 的输出分类器会立即停止该过程。

多模态交叉验证。OpenAI 的系统卡全面定义了 GPT-4o 架构中的这种能力。4o 实时跨文本、音频和视频输入运行,将多模态数据交叉验证为合法或不合法。如果音频与预期的文本或视频上下文不匹配,GPT4o 系统会将其标记出来。红队人员发现,这对于检测人工智能生成的唇形同步或视频模仿尝试尤其重要。

仅今年,针对全球最大广告公司首席执行官的数千次深度伪造尝试中,有一次针对全球最大广告公司首席执行官的尝试表明攻击者正在变得多么复杂。

另一个攻击发生在 Zoom 上,通话中有多个深度伪造身份,包括公司的首席财务官。据称,一家跨国公司的财务人员被其首席财务官和高级员工在 Zoom 通话中的深度伪造欺骗,授权了 2500 万美元的转账。

在最近与《华尔街日报》进行的技术新闻简报中,CrowdStrike 首席执行官 George Kurtz 解释了人工智能的改进如何帮助网络安全专业人员防御系统,同时还评论了攻击者如何使用人工智能。Kurtz 与《华尔街日报》记者 Dustin Volz 谈论了人工智能、2024 年美国大选以及中国和俄罗斯带来的威胁。

“现在在 2024 年,我们有能力创建深度伪造,我们的一些内部人员用我和我制作了一些有趣的恶搞视频,只是为了向我展示它有多可怕,你无法分辨视频中的人不是我,”Kurtz 告诉《华尔街日报》。“所以,我认为这是我真正担心的领域之一。我们总是担心基础设施之类的东西。在这些领域,很多事情仍然是纸质投票等等。有些不是,但你如何创造虚假叙述来让人们做国家想要他们做的事情,这才是真正让我担心的地方。”

OpenAI 将设计目标和架构框架优先考虑,将音频、视频和多模态内容的深度伪造检测放在首位,这反映了生成式人工智能模型的未来。

“过去一年人工智能的出现,使数字世界中信任的重要性成为焦点,”Telesign 首席执行官 Christophe Van de Weyer 说。“随着人工智能不断发展并变得更加容易获得,我们必须优先考虑信任和安全,以保护个人和机构数据的完整性。在 Telesign,我们致力于利用人工智能和机器学习技术来打击数字欺诈,为所有人创造一个更安全、更值得信赖的数字环境。”

VentureBeat 预计 OpenAI 将扩展 GPT-40 的多模态功能,包括语音认证和通过 GAN 检测深度伪造,以识别和消除深度伪造内容。随着企业和政府越来越依赖人工智能来增强其运营,像 GPT-4o 这样的模型在保护其系统和保障数字交互方面变得不可或缺。

Mukkamala 向 VentureBeat 強調,“歸根結底,懷疑是抵禦深度偽造的最佳防禦。必須避免以面值接受信息,並批判性地評估其真實性。”