人工智能的临界点:我们准备好迎接超级智能了吗?

人工智能领域领军人物,包括 Anthropic 的 Dario Amodei 和 OpenAI 的 Sam Altman,都认为“强大的人工智能”甚至超级智能可能在未来 2 到 10 年内出现,并可能彻底改变我们的世界。

Amodei 在其最近的论文《爱的恩典机器》中对人工智能的潜力进行了深入探讨,他认为强大的 AI(其他人称之为通用人工智能或 AGI)最早可能在 2026 年实现。与此同时,Altman 在《智能时代》中写道:“我们有可能在几千天内拥有超级智能”(即 2034 年)。如果他们的预测正确,那么在未来 2 到 10 年内,世界将发生翻天覆地的变化。

作为人工智能研究和开发的领导者,Amodei 和 Altman 站在推动技术边界的最前沿,他们的见解在展望未来时尤其具有影响力。Amodei 将强大的 AI 定义为“在大多数相关领域,例如生物学、编程、数学、工程学、写作等方面,比诺贝尔奖获得者更聪明”。Altman 在其论文中没有明确定义超级智能,但人们普遍认为,超级智能是指在所有领域都超越人类智力能力的 AI 系统。

并非所有人都认同这种乐观的预测时间表,尽管这些不太乐观的观点并没有削弱科技领袖的热情。例如,OpenAI 联合创始人 Ilya Sutskever 现在是 Safe Superintelligence(SSI)的联合创始人,这是一家致力于以安全为首要目标推动人工智能发展的初创公司。Sutskever 在去年 6 月宣布成立 SSI 时表示:“我们将直接追求安全的超级智能,专注于一个目标,一个目标和一个产品。”在谈到一年前还在 OpenAI 时的人工智能进步时,他指出:“这将是巨大的,改变世界的。将会有一个之前和之后。”在他担任 SSI 的新职位上,Sutskever 已经筹集了 10 亿美元来资助公司的努力。

这些预测与埃隆·马斯克的估计相一致,他认为人工智能将在 2029 年超越全人类。马斯克最近表示,人工智能将在未来一两年内能够做到任何人类能做的事情。他补充说,人工智能将在接下来的三年内能够做到所有人类加起来能做的事情,即在 2028 年或 2029 年。这些预测也与未来学家雷·库兹韦尔的长期观点一致,他认为 AGI 将在 2029 年实现。库兹韦尔早在 1995 年就做出了这一预测,并在其 2005 年的畅销书《奇点临近》中对此进行了阐述。

未来学家雷·库兹韦尔坚持他关于 AGI 在 2029 年实现的预测。

当我们站在这些潜在突破的边缘时,我们需要评估我们是否真正为这场变革做好了准备。无论我们是否准备好,如果这些预测是正确的,一个全新的世界将很快到来。

今天出生的孩子可能会在 AGI 改变的世界中上幼儿园。人工智能保姆还会远吗?突然之间,石黑一雄在《克拉拉与太阳》中对那些孩子在进入青春期时拥有一个安卓人工智能朋友的未来愿景似乎不再那么遥不可及。人工智能伴侣和保姆的前景预示着一个充满深刻伦理和社会转变的世界,一个可能挑战我们现有框架的世界。

除了伴侣和保姆之外,这些技术的意义在人类历史上是前所未有的,既带来了革命性的希望,也带来了生存的风险。强大的 AI 可能带来的潜在好处是巨大的。除了机器人技术进步之外,这还包括开发癌症和抑郁症的治疗方法,最终实现核聚变能源。有些人认为,即将到来的时代将是一个充满机遇的时代,人们将拥有新的创造力和联系的机会。然而,可能出现的负面影响同样重大,从大规模失业和收入不平等到失控的自主武器。

在短期内,麻省理工学院斯隆管理学院首席研究科学家安德鲁·麦卡菲认为,人工智能将增强而不是取代人类工作。在最近的 Pivot 播客中,他认为人工智能提供了“按需提供的书记员、同事和教练队伍”,即使它有时会承担“大量”工作。

但这种对人工智能影响的谨慎看法可能会有一个截止日期。埃隆·马斯克表示,从长远来看,“我们可能都不会有工作。”这种鲜明的对比突出了一个关键点:无论 2024 年关于人工智能能力和影响的哪些说法似乎是正确的,在可能只有几年之遥的 AGI 世界中,这些说法可能会发生根本性的变化。

尽管有这些雄心勃勃的预测,但并非所有人都认同强大的 AI 即将到来,或者其影响将如此直接。深度学习怀疑论者加里·马库斯一直在警告人们,当前的人工智能技术无法实现 AGI,他认为该技术缺乏必要的深度推理能力。他曾公开批评马斯克最近关于人工智能很快就会比任何人类都聪明的预测,并提供 100 万美元来证明他是错的。

Linux 操作系统创建者和首席开发人员林纳斯·托瓦兹最近表示,他认为人工智能会改变世界,但目前“90% 是营销,10% 是现实”。他认为,就目前而言,人工智能可能更多的是炒作而不是实质。

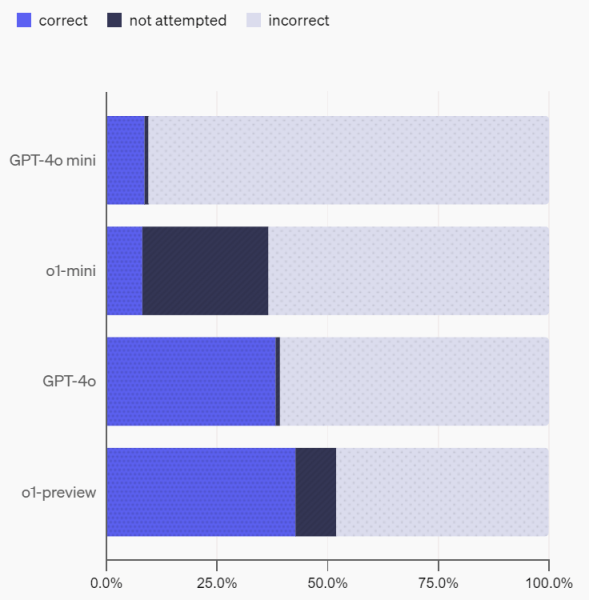

OpenAI 的一篇新论文可能为托瓦兹的说法提供了佐证,该论文表明,他们领先的尖端大型语言模型(LLM),包括 GPT-4o 和 o1,在回答存在事实答案的简单问题时遇到了困难。该论文描述了一个新的“SimpleQA”基准,“用于衡量语言模型的事实性”。表现最好的模型是 o1-preview,但它对一半的问题给出了错误的答案。

OpenAI 新的 SimpleQA 基准测试中,尖端 LLM 的表现。来源:Introducing SimpleQA。

关于人工智能潜力的乐观预测与该技术目前的现状形成了对比,正如 SimpleQA 等基准测试所显示的那样。这些局限性表明,虽然该领域正在快速发展,但要实现真正的 AGI,还需要一些重大的突破。

然而,那些最接近人工智能发展技术的人预见到快速进步。在最近的 Hard Fork 播客中,OpenAI 前 AGI 准备高级顾问迈尔斯·布伦戴奇表示:“我认为大多数了解情况的人都会同意 [AGI] 会很快到来,这对社会意味着什么,甚至无法预测。”布伦戴奇补充道:“我认为大多数人的退休时间会比他们想象的要早……”

阿玛拉定律由斯坦福大学的罗伊·阿玛拉在 1973 年提出,该定律指出,我们往往高估新技术的短期影响,而低估其长期潜力。虽然 AGI 的实际到来时间可能与最激进的预测不符,但它最终的出现,也许只需要几年时间,可能会比今天最乐观的估计更深刻地重塑社会。

然而,当前人工智能能力与真正的 AGI 之间的差距仍然很大。考虑到所涉及的风险——从革命性的医学突破到生存风险——这种缓冲期非常宝贵。它为我们提供了宝贵的时间来制定安全框架,调整我们的制度,并为一场将从根本上改变人类体验的变革做好准备。问题不仅在于 AGI 何时到来,还在于当它到来时,我们是否已经做好了准备。

加里·格罗斯曼是 Edelman 技术实践执行副总裁,也是 Edelman 人工智能卓越中心的全球负责人。

DataDecisionMakers

欢迎来到 VentureBeat 社区!

DataDecisionMakers 是一个平台,让专家(包括从事数据工作的技术人员)可以分享数据相关的见解和创新。

如果您想了解前沿理念和最新信息、最佳实践以及数据和数据技术的未来,请加入我们 DataDecisionMakers。

您甚至可以考虑 撰写文章 !

阅读 DataDecisionMakers 的更多内容