AI 即将面临的挑战:规模化发展中的能源困境

本文由 Marvell 赞助

本文是 VentureBeat 特刊“AI at Scale: From Vision to Viability”的一部分。点击此处阅读更多内容。

人工智能正在经历前所未有的快速发展,但随之而来的,是规模化发展带来的能源挑战。全球对 AI 服务的需求激增,而提供这些服务所需的能源消耗也呈指数级增长。预计 AI 算力需求将以每年 44.7% 的速度增长,到 2028 年,数据中心的电力消耗将翻倍至 857 太瓦时,这将使数据中心成为仅次于日本的全球第六大电力消耗者。这种失衡将威胁到过去 50 年推动科技发展的主要趋势——“更小、更便宜、更快”。

然而,这种趋势并非不可逆转。定制硅——针对特定用例优化的独特硅——已经证明了如何在摩尔定律失效的情况下,继续提升性能并降低功耗。到 2028 年,定制硅可能占 AI 加速器 (XPU) 的 25%(Marvell 估计),而这仅仅是定制芯片的一个类别。

英伟达 CEO 黄仁勋提出的 AI 工厂概念非常贴切。未来的 AI 数据中心将以不间断的速度运行,就像制造工厂一样,其最终成功与否将取决于运营效率。我们是否比竞争对手消耗更少能量来生成每个 token?平均故障间隔时间为何在上升?目前的设备综合效率 (OEE) 如何?在石油和化工行业,出售给客户的最终产品是不可区分的商品。它们的区别在于工艺设计,因为它们利用不同的技术组合来实现微小的增益。

AI 领域也将出现类似的情况。未来,多样性将成为主流,运营成本最低、停机时间最短、能够推出新的差异化服务和应用的运营商将成为企业和消费者的首选。

简而言之,最好的基础设施将胜出。

定制硅将成为差异化的主要方式之一,而定制硅则是由定制半导体实现的——也就是说,包含独特 IP 或功能的芯片,可以为特定应用实现跨越式性能提升。这是一个从围绕独特、单一设计构建的 AI 加速器到包含额外定制 IP、内核和固件的商用芯片的范围,以优化特定软件环境。虽然目前主要关注的是 AI 加速器等高价值芯片,但每颗芯片都将被定制:例如,Meta 最近发布了一款定制网络接口控制器 (NIC),这是一种连接服务器和网络的相对默默无闻的芯片,旨在减少停机时间的影响。

单个高带宽内存 (HBM) 堆栈可能需要一个具有 2048 个引脚的接口来传输数据,或者每个 XPU 超过 8000 个引脚。定制可以显著降低功耗、引脚数量并提高内存容量。预计一到两年内将出现带有定制 HBM 的 XPU。

定制将涉及重新思考半导体设计的各个方面。例如,一些人正在寻找优化基础芯片和接口的方法,以管理用作高端 AI 加速器缓存的千兆字节高带宽内存 (HBM)。优化可以潜在地将芯片封装内的内存提高高达 33%,将接口功耗降低 70%,并将可用于逻辑功能的可用硅面积提高近 25%(Marvell 估计)。

定制类别还包括旨在扩展计算系统规模和功能的新兴互连芯片类别。如今,服务器通常包含 8 个或更少的 XPU 和/或 CPU,所有组件都装在一个滑入机架的铝制机箱中。未来,AI 系统将包含数百个加速器以及存储器和内存,这些加速器和内存分布在多个机架上,并通过一系列针对 XPU、CXL 控制器、PCIe 重定时器、发射接收光数字信号处理器 (DSP) 和其他设备规格定制的光学引擎连接。

几年前,许多这些设备甚至不存在,但预计它们将快速增长:根据 The 650 Group 的数据,两年内 75% 的 AI 和云服务器可能包含 PCIe 重定时器。虽然这些设备和服务器将以技术标准、架构和设计为基础,但从云到云的设计将会有很大差异。

但是,如何在设计一个生产 3 纳米或 2 纳米芯片的平台需要超过 5 亿美元的市场中制造定制半导体呢?在一个大型语言模型 (LLM) 每隔几个月就会发生变化的市场中呢?这些技术将如何与冷板或浸没式冷却等新兴理念协同工作?

听起来很基础,但它始于基本要素。串行器-解串器 (SerDes) 电路是您从未听说过的“世界上最重要的技术”。这些组件控制芯片和基础设施设备(如交换机和服务器)之间的数据流。例如,一个 800G 光模块由八个 100G SerDes 组成。一个数据中心机架将包含数万个 SerDes。您可以将它们视为网络的分子:基本构建块,对整个系统的健康状况具有巨大影响。稍微降低 SerDes 传输比特所需的皮焦耳,就可以转化为全球基础设施的巨大节能。

同样,芯片封装现在在芯片设计中发挥着重要作用,因为它提供了一种机制来简化电源传输和数据路径,同时继续提高计算性能。芯片中超过 50% 的功耗可能用于将数据从芯片内部的不同子系统之间移动。

随着定制成为常态,我们也将面临一个新的困境:公司如何交付定制产品,同时仍然利用大规模制造的优势?迄今为止,半导体制造商通过制造少量设备的大量产品而取得成功。“定制”过去意味着采取一些相当简单的措施,例如调整速度或缓存大小,就像零售商可能会以几种新颜色提供相同的毛衣一样。

第一步——我们已经看到了这一点——将是更好地定义开发定制半导体所涉及的服务。一些公司可能会主要专注于芯片设计和 IP。在另一个极端,您将看到公司提供采购和可制造性服务。还有一些公司可能会专注于特定的设备和类别。只有少数几家公司将提供全面的服务组合。AI 本身也将发挥作用,将设计任务所需的时间和成本从几个月缩短到许多情况下只需几分钟。这反过来将为更多客户和更多类别的芯片打开大门。

行业会成功吗?当然。这不是我们第一次被赋予完成不可能的任务。

Raghib Hussain 是 Marvell 产品与技术总裁。

1. IDC。2024 年 9 月。

2. Statista。

3. Marvell 基于分析师报告和内部预测的估计。

4. Marvell 内部估计。

5. 650 Group 2024 年 5 月。

6. IBM

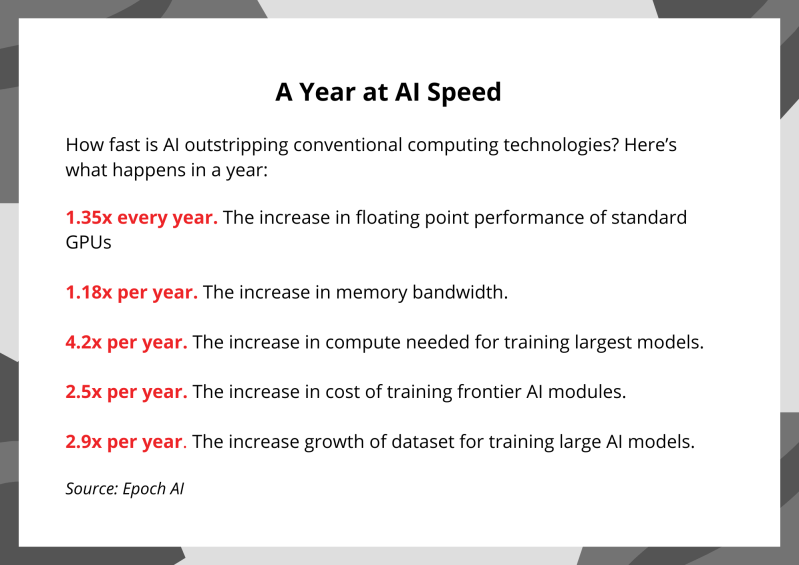

7. 图表:Epoch AI,2024 年 6 月。

本文包含联邦证券法意义上的前瞻性陈述,涉及风险和不确定性。前瞻性陈述包括但不限于任何可能预测、预测、指示或暗示未来事件或成就的陈述。实际事件或结果可能与本博客中所述的事件或结果存在重大差异。前瞻性陈述仅为预测,受难以预测的风险、不确定性和假设的影响,包括我们在向美国证券交易委员会提交的 10-K 表格年度报告、10-Q 表格季度报告和其他文件中不时描述的风险因素。前瞻性陈述仅代表其发表之日的观点。读者被提醒不要过分依赖前瞻性陈述,任何人都没有义务更新或修改任何此类前瞻性陈述,无论是因为新信息、未来事件还是其他原因。

赞助文章是由付费发布文章或与 VentureBeat 有业务关系的公司制作的内容,并且始终明确标明。有关更多信息,请联系 sales@venturebeat.com。