“`html

OpenAI的GPT-OSS:开源的惊喜与未解之谜

8月5日,OpenAI悄然发布了GPT-OSS,其光芒很快就被紧随其后的GPT-5——OpenAI迄今为止最大、最强大的大型语言模型——所掩盖。然而,GPT-OSS却以其出人意料的开放性,在AI领域掀起了一阵涟漪。

GPT-OSS(包含GPT-OSS-20b和GPT-OSS-120b两个版本)是OpenAI自2019年发布GPT-2以来,首个真正意义上“开放”的大型语言模型。采用宽松的Apache 2.0许可证,这意味着商业用途不受限制,衍生作品的授权也更加灵活。Darkviolet.ai联合创始人兼CTO Dustin Carr将其誉为“最大限度地开放的许可证”,并称OpenAI此举“非常积极,令人惊喜”。

“开放权重”的回归与策略

Apache 2.0许可证不仅允许商业化使用,还包含专利授权,为使用者构建基于GPT-OSS的应用提供了坚实的法律保障,有效避免了未来可能的专利纠纷。这与Meta的Llama和阿里巴巴的Qwen等其他流行开源模型形成了鲜明对比。虽然这些模型也提供下载,但附加条件却有所不同。

Llama的许可证要求衍生模型必须包含Llama名称并遵守Meta的品牌规范;而阿里巴巴Qwen 2.5的部分版本,特别是最大、功能最强大的版本,则受限于研究许可证,对大型组织的商业使用有所限制。OpenAI的GPT-OSS则在发布方式上也展现了其独到的策略。

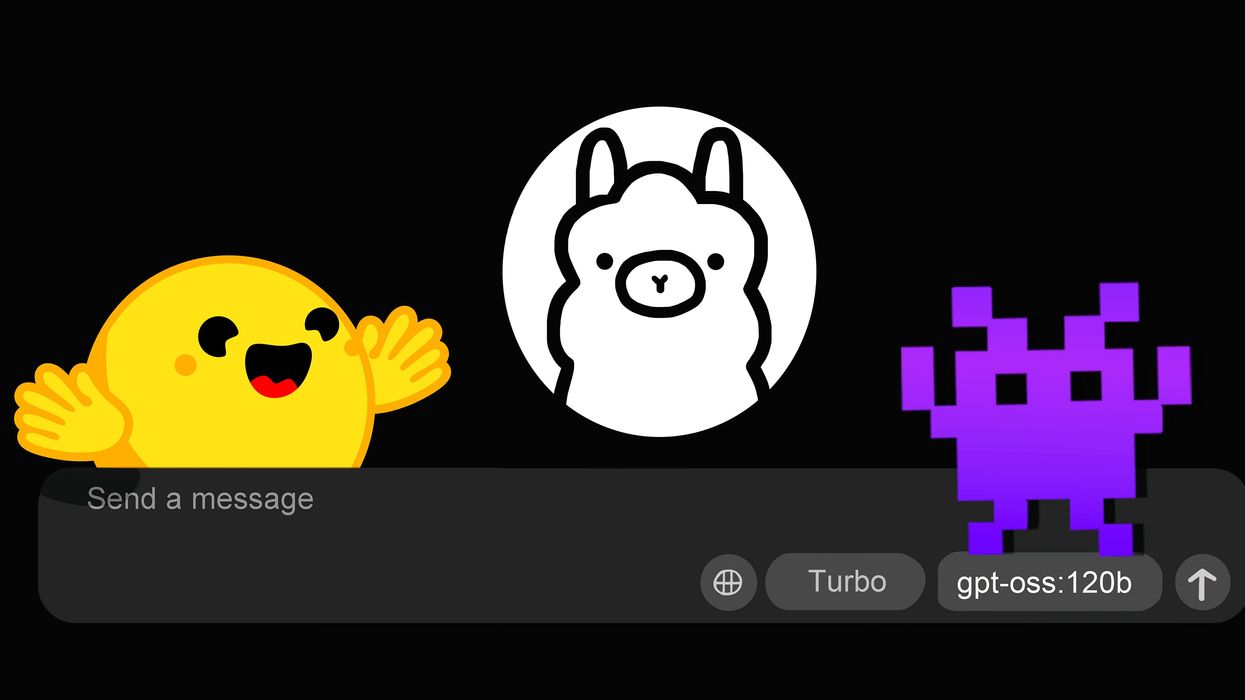

一个真正实用的开源模型,不仅需要开放的许可证,还需要广泛的可用性和对常用硬件的优化。OpenAI在Hugging Face等模型库以及Ollama和LM Studio等领先的开放式LLM前端同时发布了GPT-OSS。这些前端为用户提供了类似ChatGPT的交互界面,即使不懂代码也能轻松使用,并支持在个人电脑上运行。同时,英伟达、AMD等硬件厂商以及微软Azure和亚马逊AWS等云服务提供商也提供了及时的支持,确保模型在各种系统上都能流畅运行。

Carr评价道:“模型即刻可用,无需等待LM Studio等平台的适配,执行效率令人印象深刻。”

开放权重,并非完全开源

GPT-OSS的发布在开源AI社区引发了热烈的讨论,也暴露出了一些分歧。AI2高级研究总监兼华盛顿大学教授Hanna Hajishirzi指出:“AI的真正进步需要完全开放——不仅是开放权重,还包括开放数据、透明的训练方法、预训练和中途训练的中间检查点以及共享评估。” 开源倡议组织(OSI)也发布推文,强调了其对开源AI的定义。

关键在于,开放权重与完全开源之间存在差异。开放权重模型,例如GPT-OSS,提供了模型权重,允许用户使用和微调模型。然而,权重只是训练结果,并不包含训练数据等信息,无法从头重建模型。而OSI的开源AI定义1.0则要求公开所有训练代码和数据细节。

GPT-OSS并未满足这些要求。

GPT-OSS:引燃AI界的热潮

尽管如此,许多开发者仍然愿意忽略GPT-OSS的“不完全开源”。原因很简单:它足够好用。Carr表示,20B版本的GPT-OSS在他的M4 MacBook上可以达到每秒45到50个token的处理速度,这与一年前的小型模型相当,但由于模型规模更大,其质量有了显著提升。“同等质量下,没有哪个模型能达到如此速度。”

Bunting Labs联合创始人Brendan Ashworth认为,以完全开源的标准来衡量GPT-OSS要求过高。“指望他们开源更多内容有点吹毛求疵。”他强调了模型的免费可用性和宽松的许可证。他认为,OpenAI回归“开放权重”对开发者来说是一大胜利。

GPT-OSS的热烈反响可能会促使Meta和阿里巴巴等公司放松其许可证条款。特别是Meta,其最新开源模型Llama 4的发布并不顺利,GPT-OSS对Meta的领先地位构成了严峻挑战。

“`