Ottobots 利用 Contextual AI 2.0 将具身 VLM 应用于边缘机器人。来源:Ottonomy

自主配送机器人提供商 Ottonomy Inc. 今天宣布推出其 Contextual AI 2.0,该技术在 Ambarella Inc. 的 N1 边缘计算硬件上使用视觉语言模型 (VLM)。该公司在 CES 上表示,其 Ottobots 现在可以做出更多具有情境感知的决策,并展现出智能行为,标志着通向通用机器人智能的重要一步。

“Ottonomy 的 Contextual AI 2.0 与 Ambarella 先进的 N1 系列 SoC [片上系统] 的集成标志着自主机器人发展史上的一个关键时刻,”Ambarella 生成式 AI 和机器人总监 Amit Badlani 表示。“通过将边缘 AI 性能与 VLM 的变革潜力相结合,我们正在使机器人能够实时处理和处理复杂的现实世界数据。”

Ambarella 的单一 SoC 支持高达 34B 参数的多模态大型语言模型 (LLM),功耗低。其新的 N1-655 边缘 GenAI SoC 提供 12 路 1080p30 视频流的片上解码,同时处理该视频并运行多个多模态 VLM 和传统卷积神经网络 (CNN)。

斯坦福大学的学生使用 Solo Server 将快速、可靠且经过微调的人工智能直接部署到边缘。Ottonomy 解释说,这有助于部署 VLM 和深度模型来进行环境处理。

Contextual AI 2.0 助力机器人理解环境

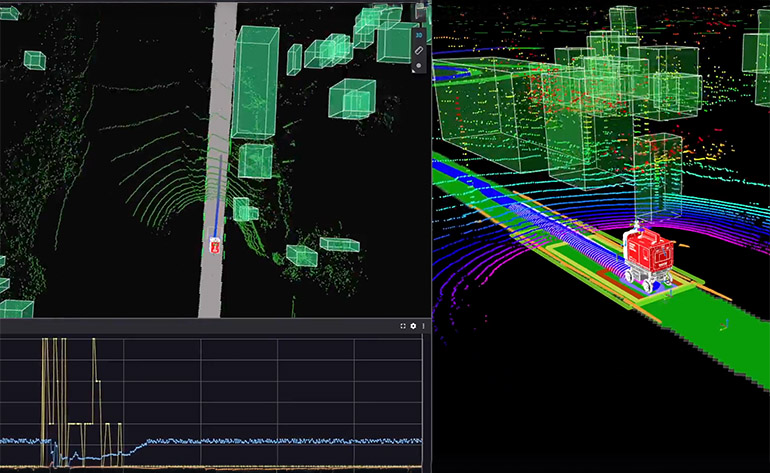

Ottonomy 声称,Contextual AI 2.0 有望彻底改变机器人的感知、决策和行为。该公司表示,该技术使其实现的配送机器人不仅能够检测物体,还能理解现实世界的复杂性,以获得更多上下文信息。

Ottonomy 解释说,凭借态势感知能力,Ottobots 可以更好地适应环境、运营领域,甚至天气和照明条件。

该公司补充说,机器人能够具有情境感知能力,而不是依赖于预先设定的行为,“是通向机器人通用智能的一大飞跃”。

“边缘硬件上的 LLM 是向通用智能迈进的关键,而我们正是将我们的行为模块融入其中,利用深度上下文并添加到我们的 Contextual AI 引擎中,”Ottonomy 首席执行官 Ritukar Vijay 表示。他将于今天下午 2:00 在拉斯维加斯曼德勒湾酒店发表演讲。

Ottonomy 看到 VLM 的众多应用

Ottonomy 断言,Contextual AI 和模块化一直是其“核心结构”,因为其 SAE 4 级自动驾驶地面机器人正在室内和室外环境中向大型制造园区交付疫苗、测试套件、电子商务包裹,甚至备件。

该公司指出,其客户遍布医疗保健、内部物流和最后一公里配送领域。

总部位于加州圣莫尼卡的 Ottonomy 表示,该公司致力于开发用于货物配送的创新和可持续技术。该公司表示,其正在全球范围内扩展业务。

立即注册,享受 40% 的会议通行证优惠!

文章“Ottonomy 推出 Contextual AI 2.0,将 VLM 应用于机器人边缘”最初发布于 The Robot Report。