MineWorld游戏画面,来自其GitHub仓库[4],采用MIT许可证发布。

对于许多人而言,童年时代最令人难以忘怀的游戏之一无疑是《Minecraft》(我的世界)。直到今天,许多玩家仍然会回想起放学后与朋友们相聚,共同探索并搭建各种新奇红石装置的乐趣。正因如此,当2024年10月,Oasis——一个自动生成的开放AI世界模型——横空出世时,它无疑震撼了整个科技界与游戏社区。它预示着利用现有技术构建能够实时响应的“世界模型”已触手可及,甚至可能在不久的将来,完全由AI生成的虚拟环境将成为现实。

“世界模型”[3]的概念最早由David HA等人在2018年提出,它们是一种机器学习模型,能够对完整的虚拟环境进行模拟并与之交互。然而,这类模型的主要局限性在于计算效率低下,这使得与模型进行实时交互成为一项重大挑战。

本博文将深入介绍由微软开发的第一个开源Minecraft世界模型——MineWorld[1]。该模型实现了快速的实时交互和高度可控性,并且相较于其闭源竞品Oasis[2],它所需的计算资源更少。MineWorld项目的核心贡献主要体现在以下三个方面:

- MineWorld:一个实现了实时交互、高可控性的开源世界模型。

- 并行解码算法:该算法显著加速了生成过程,提高了每秒生成的帧数。

- 新颖的评估指标:专门设计用于衡量世界模型的可控性。

论文链接:https://arxiv.org/abs/2504.08388

代码:https://github.com/microsoft/mineworld

发布日期:2025年4月11日

MineWorld简化解读

为了更准确地阐释MineWorld及其核心方法,本节将分为以下三个子部分进行深入探讨:

- 问题定义:明确模型所要解决的问题,并为训练和推理设定基本规则。

- 模型架构:概述用于生成令牌和输出图像的模型结构。

- 并行解码:探究作者如何利用创新的对角线解码算法[8],将每秒生成的帧数提高三倍。

问题定义

世界模型接收两种主要的输入:电子游戏画面以及玩家在游戏过程中采取的操作行为。为了能够被模型正确利用,这两种输入都需要进行不同类型的令牌化处理。

给定一段包含 n 个状态/帧的Minecraft视频片段 x,图像令牌化过程可表述如下:

x = (x1,…,xn)

t = (t1,…,tc,tc+1,…,t2c,t2c+1,…,tN)

每个帧 x(i) 包含 c 个图像块(patch),而每个图像块又可以由一个令牌 t(j) 来表示。这意味着单个帧 x(i) 可以进一步描述为一系列量化令牌的集合 {t(1), t(2),…, t(c)},其中每个 t(j) ∈ t 都是一个独特的图像块,各自捕捉着其像素集合的信息。

由于每个帧都包含 c 个令牌,因此一个视频片段中的令牌总数 N = n × c。

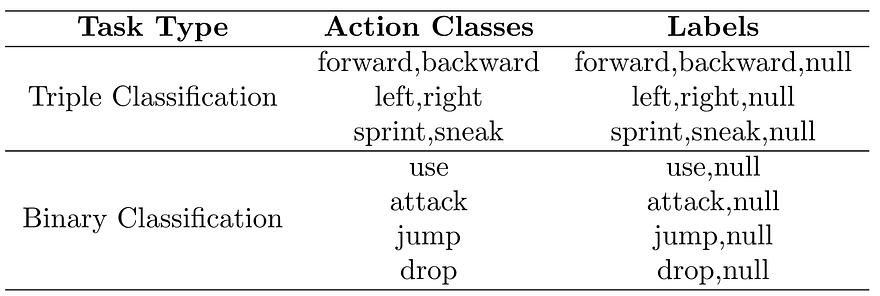

表1. 11种不同操作可能性对应的七个不同动作类别。分组参考自[1]

除了对视频输入进行令牌化处理外,玩家的操作行为也必须进行令牌化。这些操作令牌需要捕捉各种变化,例如摄像机视角的改变、键盘输入以及鼠标移动。为了实现这一点,模型使用了11个独特的令牌来表示全部的输入特征:

- 7个令牌:用于表示七个互斥的动作组。相关联的动作被归类到同一组中(动作分组如表1所示)。

- 2个令牌:根据[5]的方法编码摄像机角度。

- 2个令牌:捕捉动作序列的开始和结束,即<aBOS>(动作序列开始)和<aEOS>(动作序列结束)。

因此,一个包含所有游戏状态和操作的扁平化序列可以表示如下:

t = (ti*c+1,…,t(i+1)*c,[aBOS],tai1,…,tai9,[aEOS])

该序列首先是每个图像块的量化ID列表,从 t(1) 到 t(N)(如前述方程所示),随后是表示序列开始的令牌 <aBOS>,接着是9个动作令牌,最后是表示序列结束的令牌 <aEOS>。

模型架构

此项研究中主要采用了两种模型:一种是矢量量化变分自编码器(VQ-VAE)[6],另一种是基于LLaMA架构[7]的Transformer解码器。

尽管传统的变分自编码器(VAEs)在扩散模型广泛应用之前曾是图像生成领域的首选架构,但它们存在一些局限性。VAEs在处理离散性质数据(如单词或令牌)或需要高真实感和确定性的场景时表现不佳。而矢量量化变分自编码器(VQ-VAEs)则通过从连续潜在空间转向离散潜在空间来弥补这些不足,这使得模型结构更加规整,并显著提升了其在后续任务中的适用性。

在此论文中,VQ-VAE被用作视觉令牌化器,将每个图像帧 x 转换为其量化的ID表示 t。输入的图像尺寸为224×384像素,每张图像被进一步划分为16个大小为14×24像素的不同图像块。这一过程最终将单帧视觉信息表示为包含336个离散令牌的序列。

另一方面,研究人员采用了一个基于LLaMA架构的Transformer解码器,用于在给定所有先前令牌的条件下预测每个令牌。

fθ(t) = ∏i=1N p(ti|t<i)

该Transformer函数不仅处理基于视觉的令牌,也处理动作令牌。这使得模型能够对两种模态之间的关系进行建模,从而使其既能作为世界模型(如论文所述),也能作为能够基于先前令牌预测动作的策略模型。

并行解码

图2. 光栅扫描顺序生成(左)与并行对角线解码(右)的对比。请注意,并行解码渲染耗时2.5秒,而光栅扫描则需要约6.8秒。此可视化图由博文作者根据[1]的启发创建。

研究人员为在正常设置下使游戏达到“可玩”标准设定了明确的要求:它必须生成足够的每秒帧数(FPS),以便玩家能够舒适地执行平均每分钟操作次数(APM)。根据他们的分析,普通玩家的平均APM为150次。为了满足这一需求,模型所模拟的环境至少需要达到每秒2到3帧的运行速度。

为满足这一要求,研究人员必须放弃传统的逐像素光栅扫描式生成(即从左到右、从上到下逐个令牌生成),转而采用结合了对角线解码的方法。

对角线解码的工作原理是在单次运行中并行处理多个图像块。例如,如果图像块 x(i,j) 在步骤 t 被处理,那么图像块 x(i+1,j) 和 x(i,j+1) 则会在步骤 t+1 被同时处理。这种方法充分利用了连续帧之间的空间和时间关联,从而实现了更快的生成速度。图2中也更详细地展示了这一效果。

然而,从顺序生成切换到并行生成会带来一定的性能下降。这主要是由于训练过程与推理过程(推理时必须进行并行生成)之间存在不匹配,以及LLaMA因果注意力掩码的顺序性所致。研究人员通过使用更适合其并行解码策略的修改版注意力掩码进行微调,从而有效缓解了这一问题。

关键发现与分析

在评估阶段,MineWorld采用了VPT数据集[5],该数据集由记录的游戏片段及其对应的操作行为组成。VPT包含1000万个视频片段,每个片段由16帧组成。如前所述,每帧(224×384像素)被分割成336个图像块,每个图像块由一个独立的令牌 t(i) 表示。再加上11个动作令牌,使得每帧总计多达347个令牌,整个数据集的令牌总量达到了550亿个。

定量结果

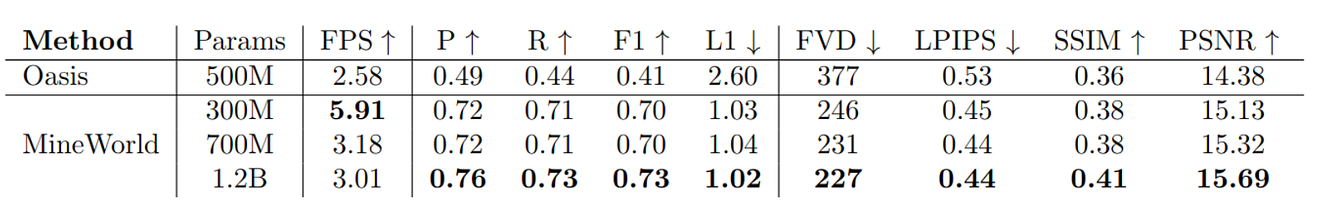

MineWorld主要通过视觉质量和可控性两大类指标,将其结果与Oasis进行了比较。

为了准确衡量可控性,研究人员引入了一种新颖的方法:训练了一个逆动力学模型(IDM)[5],其任务是预测两个连续帧之间发生的操作。该模型不仅达到了90.6%的准确率,还通过向5名经验丰富的玩家提供了20个包含IDM预测操作的游戏片段进行了进一步测试。在玩家对每个操作进行1到5分的评分并计算皮尔逊相关系数后,研究人员获得了0.56的p值,这表明预测与实际操作之间存在显著的正相关性。

鉴于逆动力学模型(IDM)能够提供可靠的结果,它可以被用于计算准确率、F1分数或L1损失等指标,具体方法是将输入操作视为真实值,并将IDM预测的操作视为世界模型产生的操作。由于所采取操作类型的多样性,这项评估可以进一步细分为两个类别:

- 离散动作分类:针对图1中描述的7个动作类别,计算其精确率(Precision)、召回率(Recall)和F1分数。

- 摄像机移动:通过将围绕X轴和Y轴的旋转划分为11个离散区间,利用IDM的预测结果计算L1分数。

表2. MineWorld三种不同设置与Oasis的比较结果。对比指标包括每秒帧数(FPS)、精确率(P)、召回率(R)、F1分数(F1)、L1分数(L1)、弗雷歇视频距离(FVD)、学习感知图像块相似度(LPIPS)、结构相似性指数(SSIM)和峰值信噪比(PSNR)。结果取自[1]

审视表2中的结果可以发现,尽管MineWorld仅拥有3亿参数,但在所有给定的指标上,无论是可控性还是视觉质量方面,它都超越了Oasis。其中最引人注目的指标是每秒帧数(FPS),MineWorld所能提供的帧数是Oasis的两倍以上,从而实现了更流畅的交互体验,能够支持每分钟354次操作(APM),远超150次APM的硬性限制。

虽然将MineWorld扩展到7亿或12亿参数能够提升图像质量,但不幸的是,这会以牺牲运行速度为代价,导致FPS降至3.01。尽管速度的降低可能会对用户体验产生负面影响,但它仍能支持可玩的180次APM。

定性结果

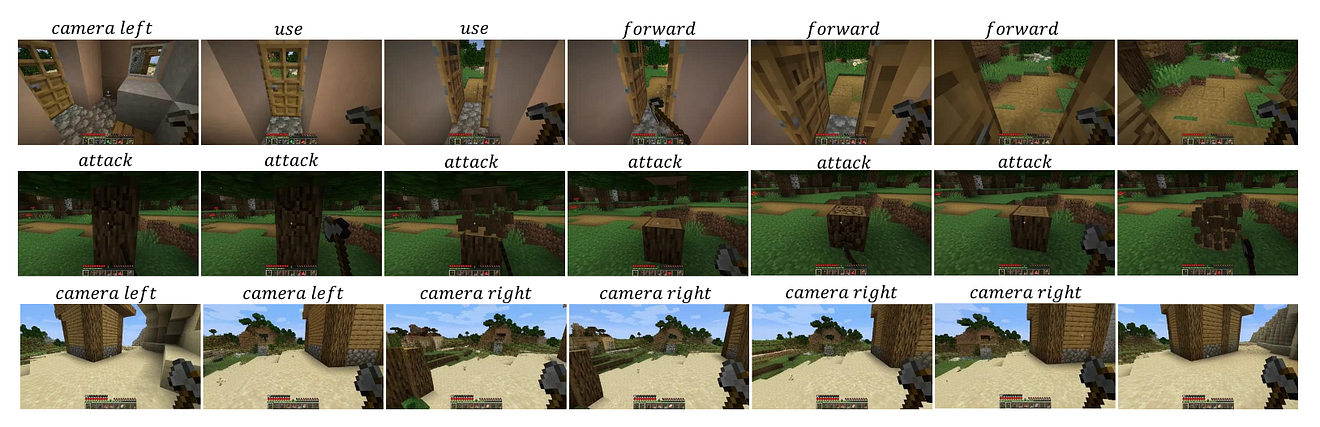

图3. 提供了三种不同的游戏场景案例。图片取自[1]

从图3中,可以得出以下三个结论:

- 顶部面板:给定玩家在房屋内的图像,并指示其走向并打开门,模型成功生成了所需的动作序列。

- 中部面板:在一个砍伐木材的场景中,模型展现了生成精细视觉细节的能力,正确渲染了木材被破坏的动画效果。

- 底部面板:这是一个高保真度和上下文感知能力的案例。当摄像机左右移动时,房屋先是移出视野,随后又带着相同的细节完整地重新出现。

这三个案例展示了MineWorld的强大之处,它不仅能够生成高质量的游戏内容,还能够忠实地遵循预设动作指令,并持续一致地重新生成上下文信息,这是Oasis等模型难以实现的功能。

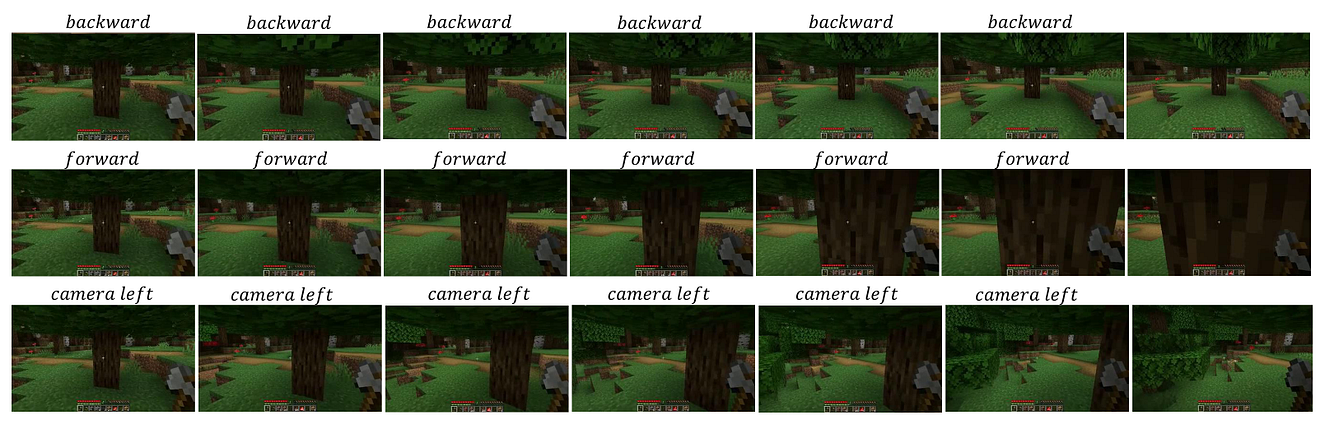

图4. 更多关于可控性的案例,在提供不同的输入操作时,模型生成了不同的游戏序列。图片取自[1]

在第二组结果中,研究人员着重评估了模型的可控性,他们提供完全相同的输入场景,但搭配了三组不同的操作指令。结果显示,模型成功生成了三个截然不同的输出序列,每个序列都导向了一个完全不同的最终状态。

总结

在本篇博客文章中,深入探讨了MineWorld——首个针对Minecraft的开源世界模型。文中详细讨论了其将每个帧/状态令牌化为多个令牌的方法,并将其与代表离散动作和摄像机移动的11个额外令牌相结合。此外,还重点介绍了其创新性地使用逆动力学模型来计算可控性指标,以及其新颖的并行解码算法,该算法将推理速度提升了三倍,平均每秒可达3帧。

展望未来,将测试运行时间延长至超过16帧的窗口将非常有价值。更长的测试时间能够准确检验MineWorld重新生成特定对象的能力,这可能仍是此类模型广泛应用面临的一大挑战。

感谢您的阅读!

有兴趣在浏览器中体验Minecraft世界模型吗?点击此处尝试Oasis[2]。

参考文献

[1] J. Guo, Y. Ye, T. He, H. Wu, Y. Jiang, T. Pearce and J. Bian, MineWorld: a Real-Time and Open-Source Interactive World Model on Minecraft (2025), arXiv preprint arXiv:2504.08388v1

[2] R. Wachen and D. Leitersdorf, Oasis (2024), https://oasis-ai.org/

[3] D. Ha and J. Schmidhuber, World Models (2018), arXiv preprint arXiv:1803.10122

[4] J. Guo, Y. Ye, T. He, H. Wu, Y. Jiang, T. Pearce and J. Bian, MineWorld (2025), GitHub repository: https://github.com/microsoft/mineworld

[5] B. Baker, I. Akkaya, P. Zhokhov, J. Huizinga, J. Tang, A. Ecoffet, B. Houghton, R. Sampedro and J. Clune, Video PreTraining (VPT): Learning to Act by Watching Unlabeled Online Videos (2022), arXiv preprint arXiv:2206.11795

[6] A. van den Oord, O. Vinyals and K. Kavukcuoglu, Neural Discrete Representation Learning (2017), arXiv preprint arXiv:1711.00937

[7] H. Touvron, T. Lavril, G. Izacard, X. Martinet, M. Lachaux, T. Lacroix, B. Rozière, N. Goyal, E. Hambro, F. Azhar, A. Joulin, E. Grave and G. Lample, LLaMA: Open and Efficient Foundation Language Models (2023), arXiv preprint arXiv:2302.13971