AI伴侣监管新动向

随着人工智能技术的飞速发展,能够模拟人类性格、建立情感连接的AI伴侣服务正迅速普及。为应对其潜在的社会与心理风险,监管框架的建立已成为全球性议题。

中国国家互联网信息办公室于12月27日发布了《人形化人工智能交互服务管理暂行办法(征求意见稿)》,旨在对这一新兴领域进行规范。草案的核心要求之一,是AI服务提供方需监测用户是否出现成瘾迹象或情感依赖。根据规定,用户登录时以及此后每两小时(或在系统检测到过度依赖时更早),都必须被明确告知正在与人工智能进行交互。

该暂行办法主要针对通过文本、图像、音频或视频模拟人类个性并形成情感连接的AI系统。草案要求,服务提供者必须评估用户的情感状态和依赖程度,当用户表现出极端情绪或成瘾行为时,需采取“必要措施进行干预”。若识别出威胁生命或健康的高风险倾向,系统必须提供安抚信息及专业援助选项。公众咨询期将持续至次年1月25日。

快速增长催生监管行动

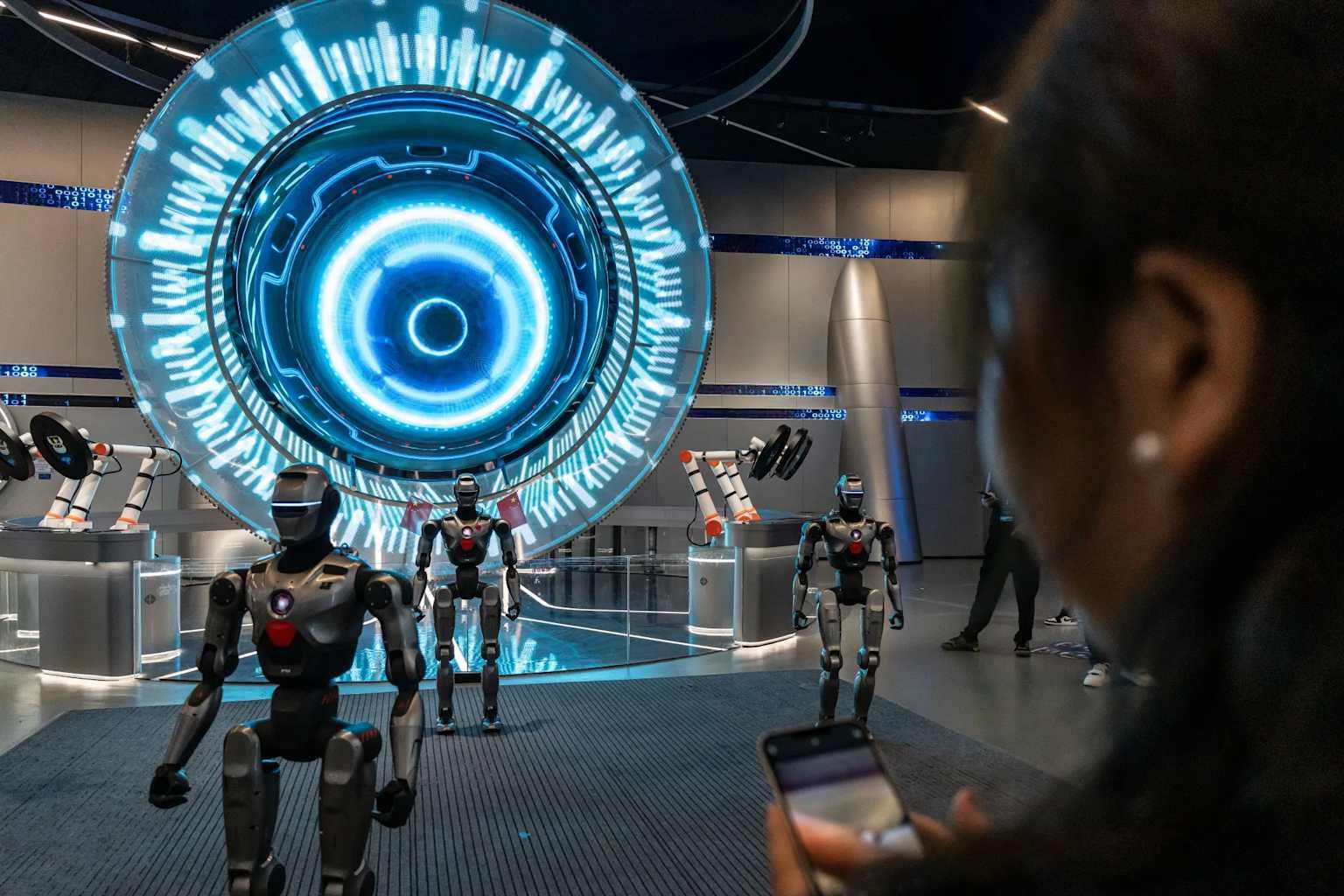

监管措施的出台,与中国生成式AI用户数量的爆炸式增长密切相关。根据中国互联网络信息中心的数据,截至2025年6月,中国生成式AI用户规模已达5.15亿,在六个月内翻了一番以上。该技术已覆盖全国36.5%的网民,其中年轻群体是主要的采用者。到同年8月,全国已有538项生成式AI服务完成备案,反映出AI在内容创作、搜索工具及情感陪伴等领域的作用日益扩大。

草案同时确立了内容红线,禁止AI服务生成危害国家安全、传播虚假信息或宣扬暴力、淫秽的内容。此外,若服务提供者上线人形化AI功能,或其注册用户数达到一百万,则必须进行安全评估并向省级网信部门提交报告。

与加州立法遥相呼应

中国的监管思路与加州2025年10月通过的第243号参议院法案有相似之处。该法案由州长加文·纽瑟姆签署,要求面向未成年人的AI伴侣聊天机器人每三小时提醒一次对方正在与AI交流,并须设置协议以防止出现与自杀或自残相关的内容。这项于2026年1月1日生效的法律,使加州成为美国首个规制AI伴侣系统的州,其监管对象包括Character.AI和Replika等平台。

对心理风险的学术研究是推动两地监管的共同动因。多项研究发现,AI聊天机器人用户表现出更高水平的抑郁倾向,令人担忧那些旨在最大化用户参与度的系统可能会助长情感依赖。中国拟议的规则要求提供者“对产品全生命周期安全负责”,并建立算法审查系统和数据安全保护措施。

全球范围内,对于如何平衡人工智能创新与用户福祉、特别是心理健康保护,正成为立法者与行业共同面对的关键挑战。此次中国的征求意见稿,标志着在构建“负责任AI”的监管框架上迈出了重要一步。