别了,提示词工程师:AI交互的未来是“所见即所得”

洞察· 原作者:AccessPath 研究院· 6 分钟阅读0 阅读

我们正经历一个怪圈:史上最聪明的AI,却让我们用回了40年前的命令行界面。这种基于文本提示词的交互,是技术早期的妥协,而非设计的进步。它违背了图形界面发展的全部历史。未来,AI的价值不在于让人类学习如何更好地“提问”,而在于让工具无缝融入可视化工作流,实现真正的“所见即所得”。

一、AI最大的谎言:对话框就是未来

一个闪烁的光标,一个空白的输入框。这是我们今天与最顶尖人工智能交互的方式。

这幅场景,与其说充满未来感,不如说是一次彻底的“文艺复兴”——复兴到了1980年代的DOS命令行时代。过去四十年,从苹果Macintosh的图形界面到智能手机的触摸屏,人机交互的整个发展史,就是一部努力消灭命令行的历史。我们用点击、拖拽、滑动代替了晦涩的指令,让普通人也能直观地与机器沟通。

然而,生成式AI的浪潮,却似乎让我们一夜回到了解放前。我们再次被要求将脑海中复杂的、视觉化的、空间化的想法,翻译成机器能够理解的、线性的、刻板的文字。这不仅是体验的倒退,更是一种结构性的失败。

二、当“看见”被降维成“诉说”

问题的核心在于信息损耗。

认知心理学中的“双重编码理论”早已揭示,人类通过视觉和语言两个独立的通道处理信息。视觉通道的带宽远超语言,它能以极高效率传递空间、比例和关系等复杂信息。根据麻省理工学院(MIT)的研究,人脑处理一张图片最快只需13毫秒。

试想一个简单的任务:描述一个螺旋楼梯。如果只用语言,不借助任何手势,可能需要数百字才能勉强说清其结构、材质和光影,且听者脑中的图像依然模糊。但画一张草图,只需五秒钟,信息传递精准无误。

当前的AI提示词交互,正是在强迫我们用低效的语言通道,去描述本应属于视觉通道的创意。设计师脑中的构图、导演脑中的分镜、建筑师脑中的空间感,都被迫进行“降维翻译”。在这个过程中,创意的精髓大量流失。我们得到的,往往是“忠实于字面意思,但完全不是我想要的”的结果。

三、工程师的路径依赖,用户的认知负担

这场交互设计的倒退,并非偶然。

首先,这是技术上的“路径依赖”。大型语言模型(LLM)天生以文本为母语,对话框自然成了最快、最容易实现产品化的“最小可行界面”。在AI的淘金热中,速度压倒了一切,用户体验被暂时搁置。

其次,这反映了早期AI工具创造者的文化偏见。主导这波浪潮的是软件工程师,他们是命令行最忠实的用户,视其为精确、高效的终极工具。他们下意识地为“同类”设计了产品,却忽略了设计师、艺术家、音乐家等创意工作者的思维方式是视觉化、非线性的。

这种错位,直接催生了“提示词工程”(Prompt Engineering)这门“显学”。用户需要学习如何遣词造句、调整权重、添加魔法词汇,才能“驯服”AI。这本质上是重新为用户树立了一道技术门槛,完全违背了Don Norman在《设计心理学》中强调的“示能性”原则——好的设计应该让人一看就知道怎么用。一个空白的对话框,恰恰是示能性的反面:它什么都没告诉你,却要求你什么都得知道。

四、中国市场的启示:没人想和App聊天

将视线投向中国市场,这种“文本先行”的交互模式显得更加格格不入。

中国的互联网用户早已被微信、淘宝、美团等“超级App”培养出了截然不同的使用习惯。这些平台的核心是高度整合的图形化界面,用户通过点击、滑动和选择,在同一个视觉框架内完成从社交、购物到出行、点餐的复杂任务。这里的逻辑是“嵌入”与“融合”,而不是“切换”与“对话”。

想象一下,如果滴滴打车不是让你在地图上选点,而是弹出一个对话框问“你想去哪,请用精确的语言描述”,这无疑是场灾难。中国的AI产品想要真正落地,就必须尊重这种根深蒂固的“所见即所得”的交互文化。

美图旗下的AI工具提供了一个正面范例。它没有另起炉灶做一个聊天机器人,而是将“AI换装”、“智能消除”等功能,以按钮、滑块和选区的形式,无缝地融入其成熟的图片编辑界面中。用户在熟悉的画布上直接操作,AI在幕后完成繁重的计算。这才是AI工具应有的形态:它应该是画布上的画笔,而不是站在你身后的监工。

五、告别命令行,回归“直接操作”

幸运的是,改变正在发生。全球范围内,领先的工具已经开始摆脱“对话框”的束缚,回归图形界面的本质——直接操作。

- 画布即指令:tldraw的“Make Real”功能,允许用户手绘一个粗糙的界面草图,AI能直接将其转化为可用的代码。在这里,画图本身就是指令,无需任何文字翻译。

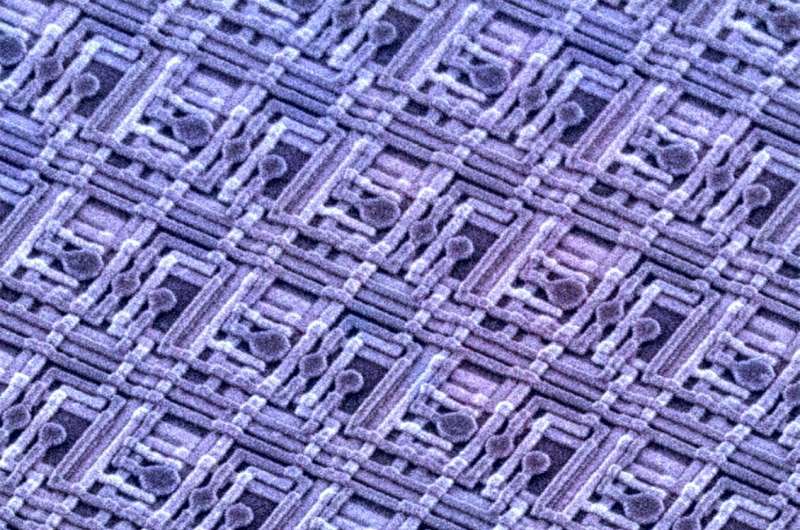

- 空间即逻辑:ComfyUI为Stable Diffusion设计了节点式编辑器,用户通过拖拽连接不同的功能模块,将复杂的生成流程以一张直观的逻辑图呈现出来。整个工作流一目了然,可随时修改和调试。

- 工具即AI:Adobe在Photoshop中加入的“生成式填充”功能是最好的例子。用户用熟悉的选框工具圈出一片区域,输入简单的词语(如“添加一只鸟”),AI便在选区内完成创作。80%的操作是视觉的、直接的,文本只扮演了辅助角色。

这些探索共同指向一个未来:AI不再是一个需要通过特定语言去沟通的“异类”,而是被整合进现有工作流,成为一种可以被直接操控的强大能力。

结语:未来没有“提示词工程师”

“提示词工程师”这个一度被热炒的职业,更像是当前AI交互范式不成熟的产物。它要求人类去学习机器的语言,而不是让机器更懂人的意图。当AI的交互真正成熟时,我们需要的不是更会写提示词的人,而是更有创造力和审美判断力的“导演”。

AI交互的终局,不是让我们成为更出色的“提问者”,而是让“提问”这个动作本身消失。未来属于那些能让用户通过视觉、手势和直接操作来表达意图的工具。我们将重新在屏幕上指点江山,而不是对着一个空洞的文本框苦思冥想。

标签:AI

想了解 AI 如何助力您的企业?

免费获取企业 AI 成熟度诊断报告,发现转型机会

//

24小时热榜

热门标签

关注公众号

扫码关注,获取最新 AI 资讯

免费获取 AI 落地指南

3 步完成企业诊断,获取专属转型建议

已有 200+ 企业完成诊断