洞察

趋势分析、行业评论、深度报道

你的XGBoost模型,为何预测不了公司的未来?

大模型安全新范式:从内容审查到“心电图”监控

代码已死?AI正在重写软件开发的游戏规则

AI Agent开发,别再只用Python“粘胶水”了

别只谈大模型了,RAG才是应用落地的真功夫

AI产品狂飙:我们造出了F1赛车,却忘了装刹车

AI没颠覆学习,只是捅破了教育的“窗户纸”

AI正在终结“语法时代”,程序员的新价值在哪里?

别再迷信XGBoost了,它根本不懂未来

AI安全需要“警察”还是“医生”?

AI音乐爆火,但你的对手不是周杰伦

AI淘金热的最大误区:赢家不是淘金者

AI没有颠覆教育,只是扯下了皇帝的新衣

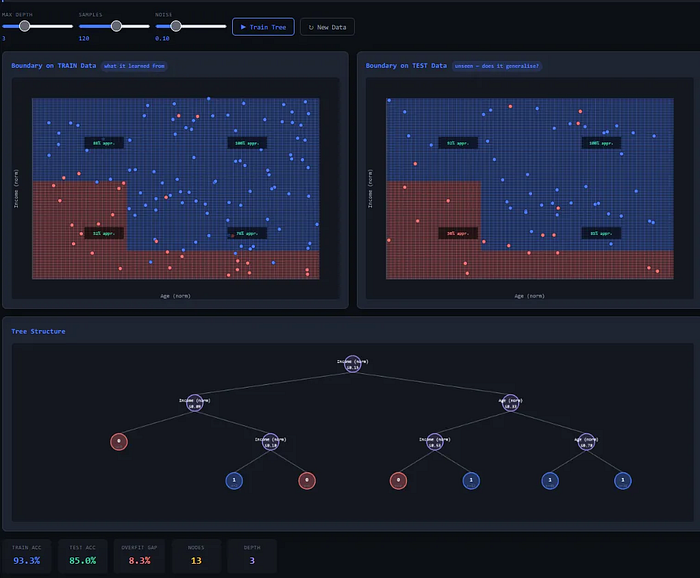

为什么你的XGBoost模型,永远在追赶未来?

AI安全新范式:别再审查内容了,给大模型装个“心率监测仪”