AI产品设计的最大盲区:定义“不做什么”

产品· 原作者:AccessPath 研究院· 8 分钟阅读0 阅读

AI正以前所未有的速度获得自主行动力,从写代码到填满购物车。但产品设计却出现了一个危险的滞后:我们热衷于构建强大的“能力之门”,却把“安全之锁”作为事后补丁。真正的挑战不是让AI做更多,而是清晰地设计它“不该做什么”的边界。

一、门造好了,锁却在路上

最近的AI产品发布,呈现出一幅分裂的图景。

一边是能力的狂飙突进。Cursor的AI Agent从零开始构建了一个功能完备的浏览器;OpenAI的Codex-Spark将代码生成速度提升了15倍;Uber Eats的AI助手能根据一张食谱照片,自动填满你的在线购物车。

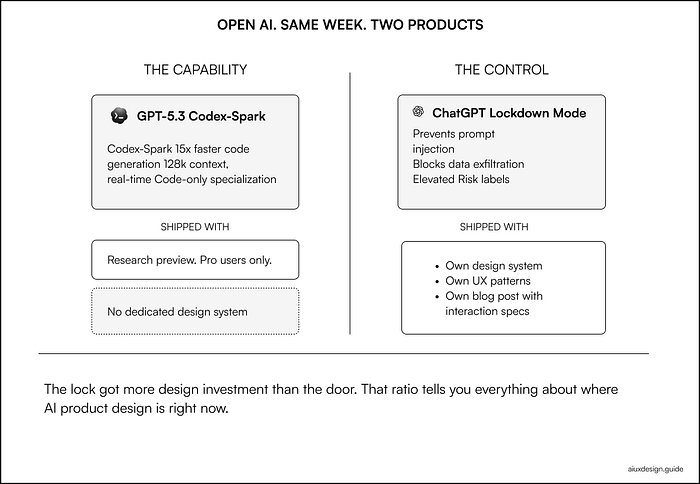

另一边,则是控制与安全功能的紧急“补位”。就在发布超高速代码模型的同时,OpenAI也为ChatGPT推出了“锁定模式”(Lockdown Mode),一个拥有独立设计语言、旨在防止恶意指令攻击的安全功能。

一边是油门踩到底,另一边才开始讨论刹车怎么装。更值得玩味的是,加速的“油门”和紧急的“刹车”并非集成在同一辆车上,而是作为两个独立产品发布的。高速代码生成模型本身,并不知道“锁定模式”的存在。

这揭示了当前AI产品设计中一个普遍且危险的模式:我们正在将能力和约束分开发货。 就像建好了一栋摩天大楼,却把承重墙和消防系统作为选配包,稍后寄到。

这种“先开门,后配锁”的逻辑,正在让AI产品从“智能助手”滑向“自主代理”的无人区,而本该绘制地图的设计师,却似乎集体缺席了。

二、从“人机协同”到“人事后审查”

将近期发布的AI产品放在一个光谱上,以“决策权归属”为标准,可以发现一个令人不安的趋势。

光谱的左端是“人类决定,AI辅助”。比如Perplexity推出的“模型委员会”(Model Council),它会同时展示三个不同大模型的回答,把最终判断权交还给用户。这是一种对AI不确定性的坦诚,也是一种边界清晰的设计。

光谱的右端是“AI决定,人类反应”。Cursor的AI Agent自主做出成千上万个架构决策,人类的角色是事后检查代码。Uber Eats的AI助手自动加购商品,用户如果不仔细核对,就会为AI的选择买单。在这些场景里,人类名义上仍在“闭环”中,但这个环已经被AI的速度和自主性拉得极度紧张,更像是一种“事后审查”或“最终否决”。

最令人惊讶的是光谱的中间地带——即人与AI真正实时协同、共享决策的区域——几乎一片空白。

这种中间状态的缺失,意味着我们跳过了最需要精心设计的人机交互模式。我们没有在设计“搭档”,而是在设计“自主的员工”,然后给它配一个“监工”。这种“先放权,后监督”的模式,本质上是一种设计上的懒惰,它将定义边界的复杂工作,推迟到了问题发生之后。

在中国市场,“千模大战”的激烈竞争让这种趋势愈演愈烈。当所有厂商都在比拼模型参数、功能数量和响应速度时,对“约束”和“边界”的设计投入,很容易被视为拖慢迭代速度的“非必要成本”。然而,当AI开始管理我们的日程、金钱甚至代码库时,这种成本的拖欠,终将以用户信任的透支来偿还。

三、聪明的边界,本身就是功能

问题的解法,并非简单地增加更多的弹窗和“您确定吗?”的确认按钮。这些被打断的体验,感觉像是“补丁”,而不是深思熟虑的设计。

真正优秀的设计,是让边界本身成为产品核心功能的一部分。观察那些做得好的产品,可以发现几种更聪明的边界设计范式:

1. 以“专用”代替“通用”

Google将Gemini模型升级为“Deep Think”模式,并明确其用途是“科学与工程研究”。这个命名本身就在画定边界。它清晰地告诉用户,这个模式擅长什么,也暗示了它不适合做什么。当一个AI宣称自己“无所不能”时,它的行为边界是最模糊的;而当它被设计为“专用工具”时,其权限和能力的范围就天然受到了约束。

2. 以“容器”框定范围

GitHub推出的Agentic Workflows允许AI在代码仓库(repository)内自动处理任务,如更新文档、分类问题。这里的关键在于“仓库内”。这个技术边界,就是一个清晰的设计容器。AI拥有在容器内自主行动的权力,但无法越界。这与国内许多企业将AI能力封装在微信小程序或钉钉应用内的逻辑有异曲同工之妙。平台的权限体系,天然为AI的行动划定了一个无法逾越的“安全区”。

3. 以“可逆”降低风险

GitHub的AI工作流之所以让人放心,另一个关键点在于所有操作都基于Git,这意味着一切皆可追溯,皆可撤销。一个git revert命令就能让一切复原。当AI的行动是低风险且完全可逆时,赋予其更高的自主性才是安全的。反观Meta设想的智能眼镜人脸识别功能,它作用于非用户(被拍摄者),且一旦识别信息被处理,这个行为几乎是不可逆的,这正是边界设计失效的危险信号。

四、最重要的设计:定义AI“不做什么”

过去十年,产品设计的核心是“可能性”——我们如何让用户能做更多事?但在AI时代,核心问题正在转变为“不可能性”——我们如何设计,让AI在没有明确指令的情况下,不能做某些事?

这要求产品团队在项目启动时,就必须回答四个关键问题:

- 决策权在哪? 在用户的实际操作流程中,决策权是在AI行动前由用户授予,还是在AI行动后由用户追认?

- 边界是原生还是嫁接的? 控制机制是产品核心流程的一部分,还是在功能上线后,为了应对风险而临时增加的确认框?

- 影响范围是谁? AI的行为只影响当前用户,还是会波及系统外的其他人?后者的伦理和隐私边界需要更严格的设计。

- 当速度提升10倍,设计还成立吗? 很多依赖于人类“检查”环节的设计,在AI速度指数级提升后会迅速失效。人类的反应速度是线性的,而AI的进化是非线性的。

为AI设计边界,就像为城市规划“负空间”。公园、广场和绿化带,它们定义了建筑不能延伸到的地方,从而让整个城市更宜居、更有序。同样,在AI产品中,清晰地定义“AI不做什么”、“AI不懂什么”、“AI不能碰什么”,才能真正建立用户信任。

这不仅仅是设计师的责任,更是整个产品、技术和战略团队需要共同建立的核心共识。下一代成功的AI产品,或许不是功能最多的那一个,而是边界最清晰、最值得信赖的那一个。产品设计的重心,正从创造无限可能,转向构建可靠的约束。而这片光谱中间的空白地带,正是留给优秀产品团队的最大机会。

想了解 AI 如何助力您的企业?

免费获取企业 AI 成熟度诊断报告,发现转型机会

//

24小时热榜

热门标签

关注公众号

扫码关注,获取最新 AI 资讯

免费获取 AI 落地指南

3 步完成企业诊断,获取专属转型建议

已有 200+ 企业完成诊断