英伟达发布Nemotron 3 Super,专为自主智能体设计

产品· 原作者:AccessPath 研究院· 3 分钟阅读1 阅读

英伟达发布拥有1200亿参数的开放权重AI模型Nemotron 3 Super,专为多智能体自主系统设计。该模型采用混合Mamba-Transformer架构,吞吐量提升5倍,准确率翻倍,已在多个云平台上线。英伟达通过免费高性能模型巩固其硬件生态优势。

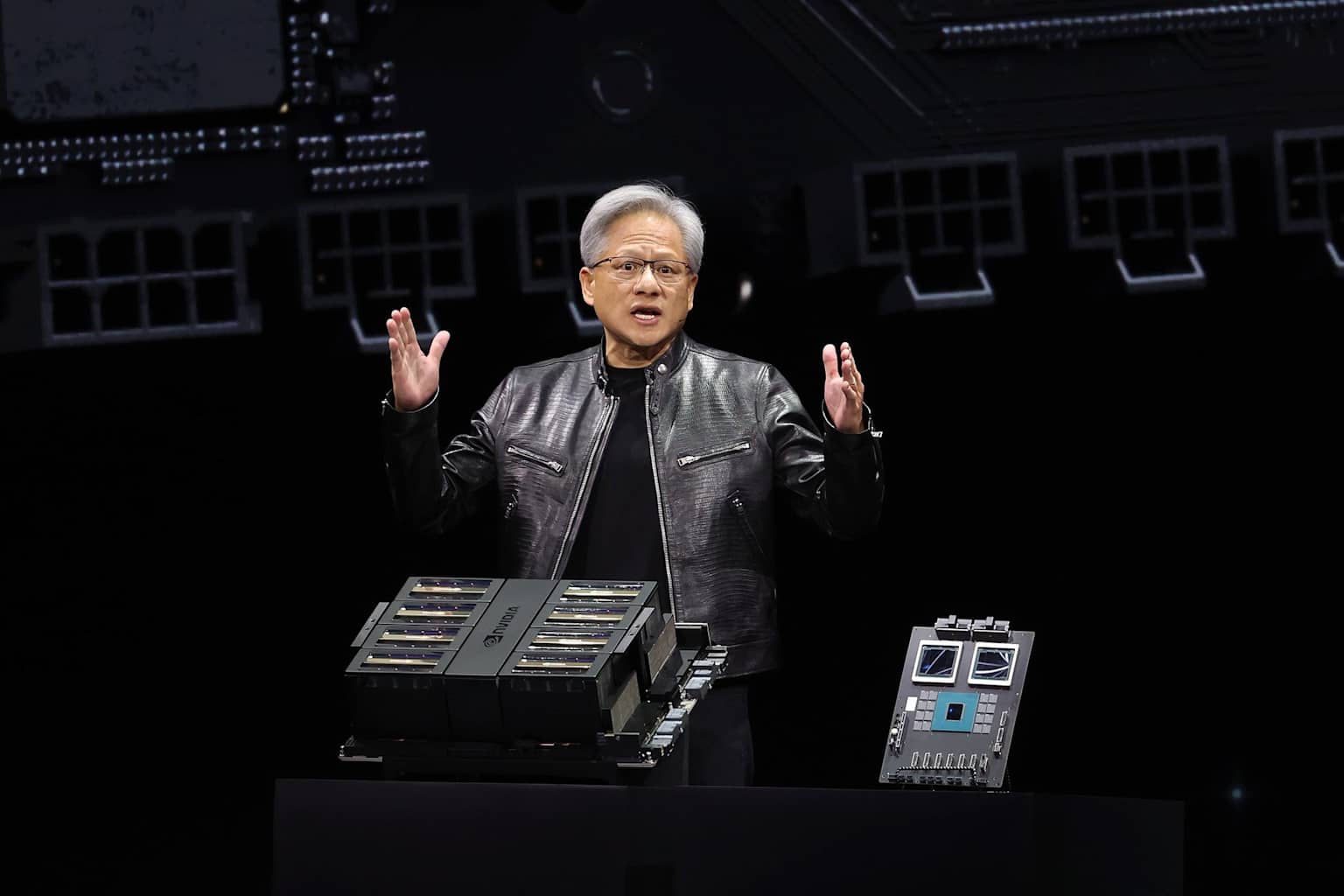

英伟达于周二发布了Nemotron 3 Super,这是一个拥有1200亿参数的开放权重AI模型,专为多智能体自主系统设计。这标志着这家芯片制造商在主导从聊天机器人向AI智能体转型的基础设施层方面迈出了重要一步。

该模型采用混合Mamba-Transformer专家混合架构,每个token仅激活120亿个参数。据英伟达称,相比前代Nemotron Super模型,吞吐量提高了多达5倍,准确率提高了多达2倍。它具有100万token的上下文窗口,在英伟达的Blackwell平台上运行,使用NVFP4精度,这减少了内存需求,推理速度比其较旧的Hopper系统上的FP8快多达4倍。

开放权重与广泛的合作伙伴生态系统

英伟达以宽松许可证发布了Nemotron 3 Super的开放权重,同时公开了其训练方法、强化学习环境和评估协议。该模型可通过英伟达自有平台、Perplexity、OpenRouter和Hugging Face访问,云端部署方面已在谷歌云Vertex AI和甲骨文云基础设施上线。亚马逊云科技和微软Azure的支持也在计划之中。StreetInsider报道

部署该模型的合作伙伴横跨多个行业:Perplexity正在使用它来增强搜索和自主代理功能,而戴尔和慧与正在将其集成到企业解决方案中。Palantir、西门子和达索系统等组织正在将其应用于工作流自动化。包括Edison Scientific和Lila Sciences在内的生命科学公司,以及CodeRabbit和Factory等软件开发公司也都是早期采用者。

基准测试与市场地位

独立基准测试机构Artificial Analysis获得了早期访问权限,在其智能指数中为Nemotron 3 Super评分36分——比上一代Super版本高出17分。该机构称其为“迄今为止在如此开放程度下发布的最智能模型”。在吞吐量测试中,该模型在每个Nvidia B200 GPU上的吞吐量比OpenAI的gpt-oss-120b高出11%,不过在原始智能评分方面落后于最近发布的Qwen3.5 122B。LinkedIn分析

战略背景

这次发布兑现了英伟达在2025年12月推出Nemotron 3系列——Nano、Super和Ultra——时制定的路线图,当时承诺在2026年上半年推出更大规模的模型。英伟达应用深度学习研究副总裁Bryan Catanzaro在LinkedIn上宣布了这一发布,将该模型描述为“120B-12A混合SSM潜在MoE,专为Blackwell设计,使用NVFP4预训练”。

此次发布凸显了英伟达的战略:提供免费、高性能的开放模型,使开发者持续基于其硬件生态系统进行构建,即使中国的开源竞争对手正在崛起,而闭源模型实验室也越来越多地设计自己的芯片。The Rundown分析

想了解 AI 如何助力您的企业?

免费获取企业 AI 成熟度诊断报告,发现转型机会

//

24小时热榜

热门标签

关注公众号

扫码关注,获取最新 AI 资讯

免费获取 AI 落地指南

3 步完成企业诊断,获取专属转型建议

已有 200+ 企业完成诊断